Rocket.Chat AI ofrece inteligencia segura e in situ que respeta las normas de clasificación y acceso

, lo que permite a los equipos actuar con mayor rapidez, confiar en todas las respuestas y proteger los datos críticos para la misión.

La IA que escapa a tu control supone un riesgo para la misión. Cuando tu modelo no es soberano, auditable o está alineado con las políticas de clasificación y acceso, cada respuesta se convierte en un riesgo para la inteligencia.

Exponen información confidencial cuando operan fuera de su enclave seguro.

pone en peligro las misiones cuando la IA no puede demostrar la fuente, el linaje o el contexto.

ocurren cuando la IA elude los controles de acceso o los límites de clasificación.

Rocket.Chat permite obtener inteligencia de misión con IA soberana, modelos alineados con la doctrina, acceso controlado y procedencia verificada, de modo que cada información sea fiable, conforme y lista para su uso operativo.

Mantenga toda la información interna, enriquezca con el contexto de la misión y mantenga un control total sobre los datos confidenciales de propiedad exclusiva.

Sovereign AI: Ejecute la IA en sus enclaves seguros con control total sobre los datos y el conocimiento, manteniendo toda la información segura.

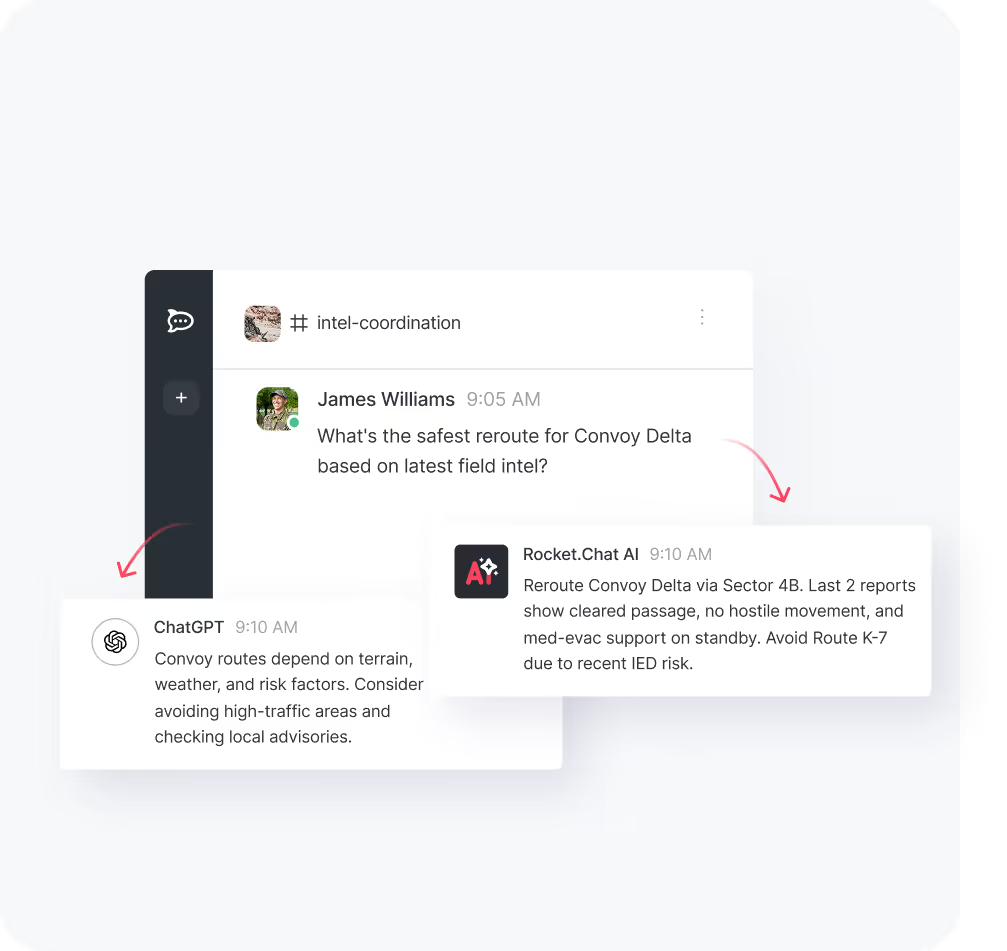

Flexibilidad de modelos: admite cualquier modelo de IA, incluido BYO LLM, para satisfacer las necesidades de la misión y evitar la dependencia de un único proveedor.

Ciclo de vida del conocimiento: Versión , caducidad y reindexación automática de datos para mantener la inteligencia actualizada y fiable.

Ingesta segura: ingesta datos privados de forma segura mientras los mantiene completamente contenidos y protegidos.

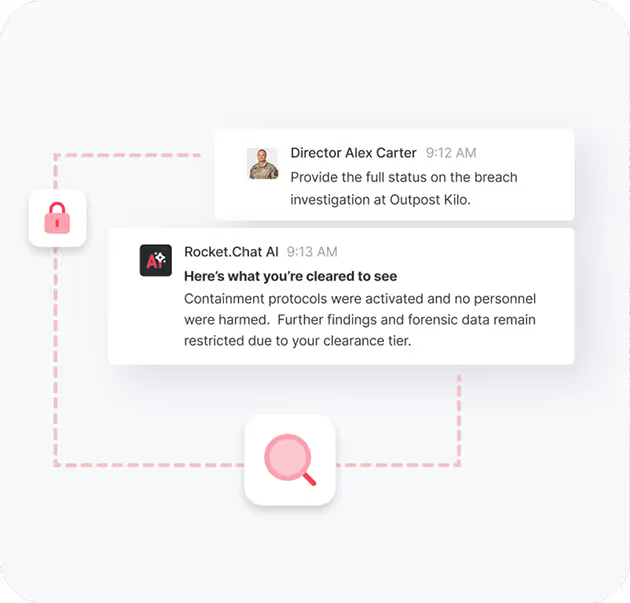

Asegúrese de que la IA respete los niveles de autorización, las funciones y las políticas internas para mantener la inteligencia confidencial protegida, auditable y alineada con los estándares de la misión.

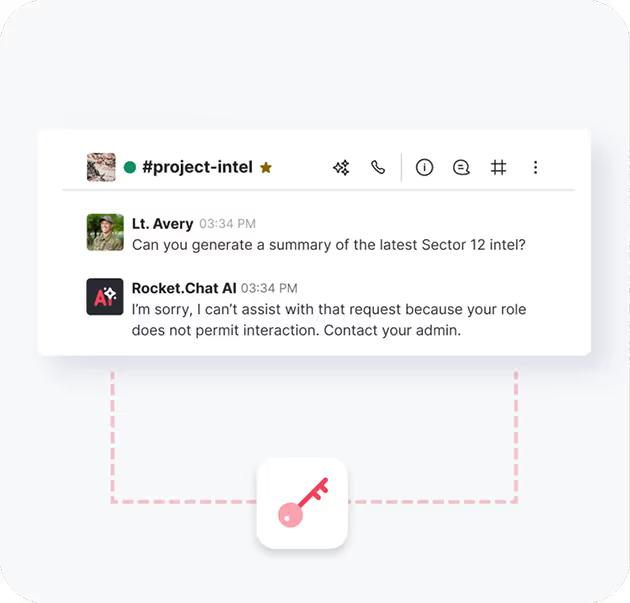

Asegúrate de que solo el personal autorizado pueda activar consultas de IA o gestionar procesos, manteniendo la seguridad de todas las operaciones.

Revisa las indicaciones de riesgo y aplica las políticas, clasificaciones y reglas de autorización para evitar fugas de datos.

Proporcione información de IA solo a usuarios autorizados, respetando la confidencialidad y la clasificación de los datos para proteger completamente la información.

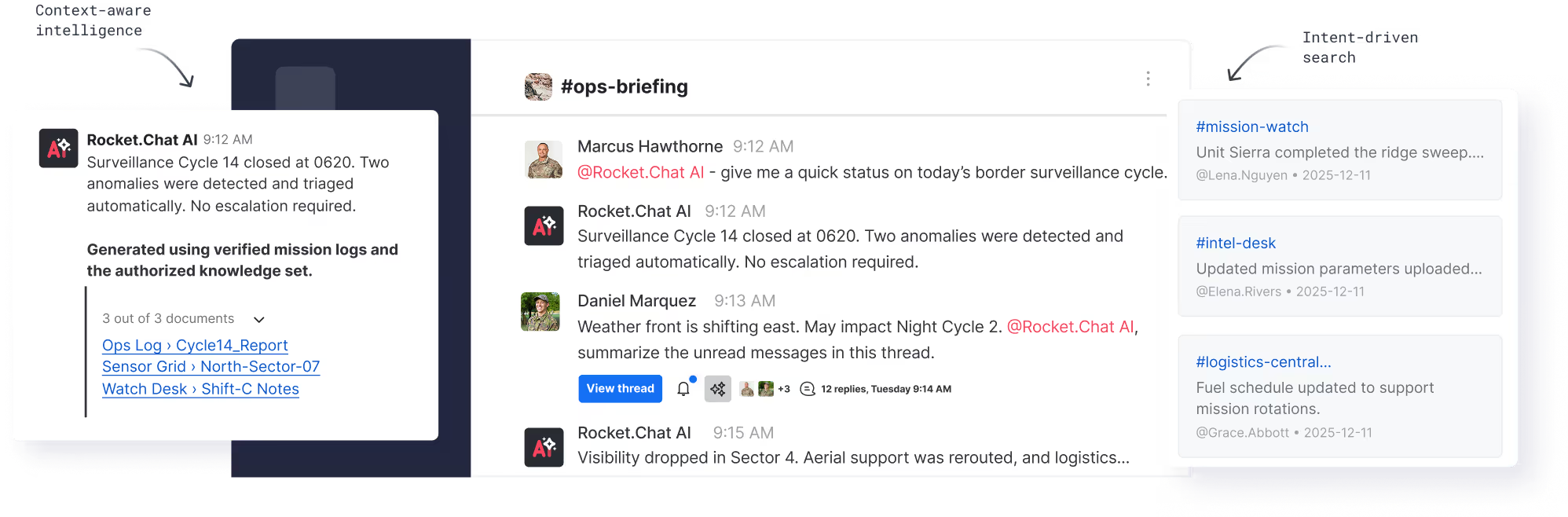

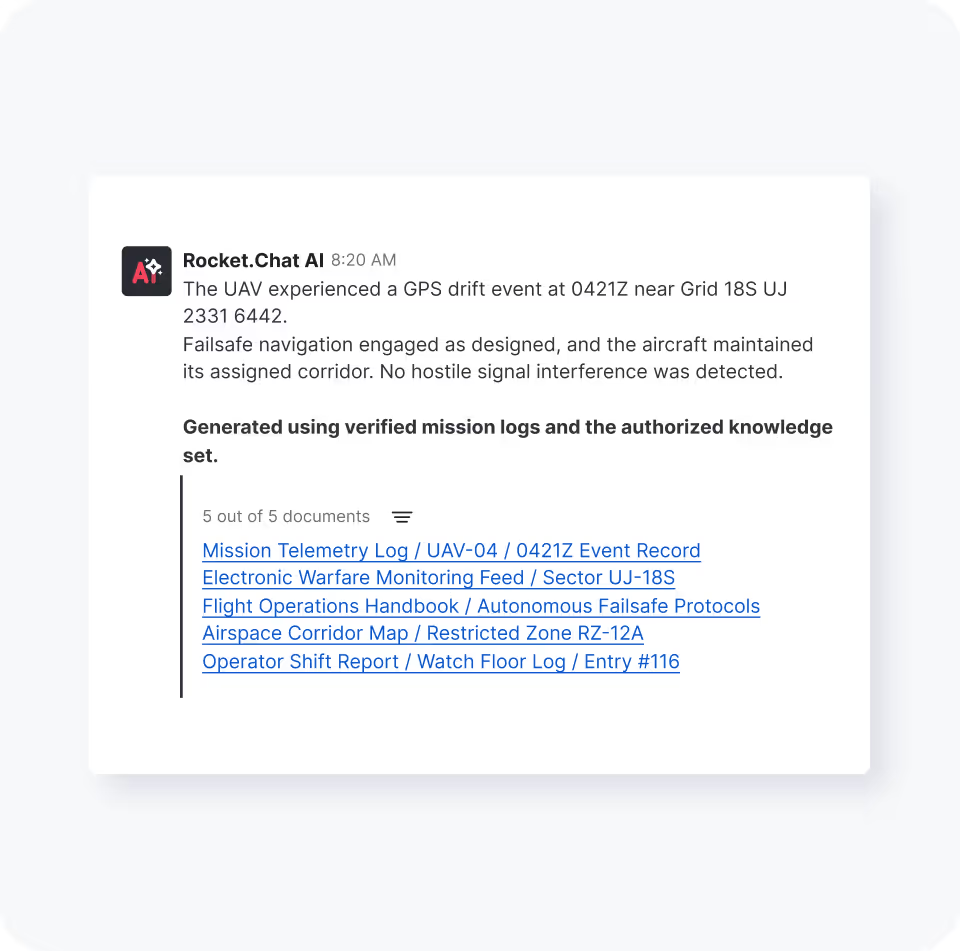

Convierta la IA en un socio fiable para sus misiones, en lugar de una caja negra. Obtenga información basada en conocimientos verificados, con fuentes trazables y que se pueda aplicar de forma inmediata para tomar decisiones urgentes.

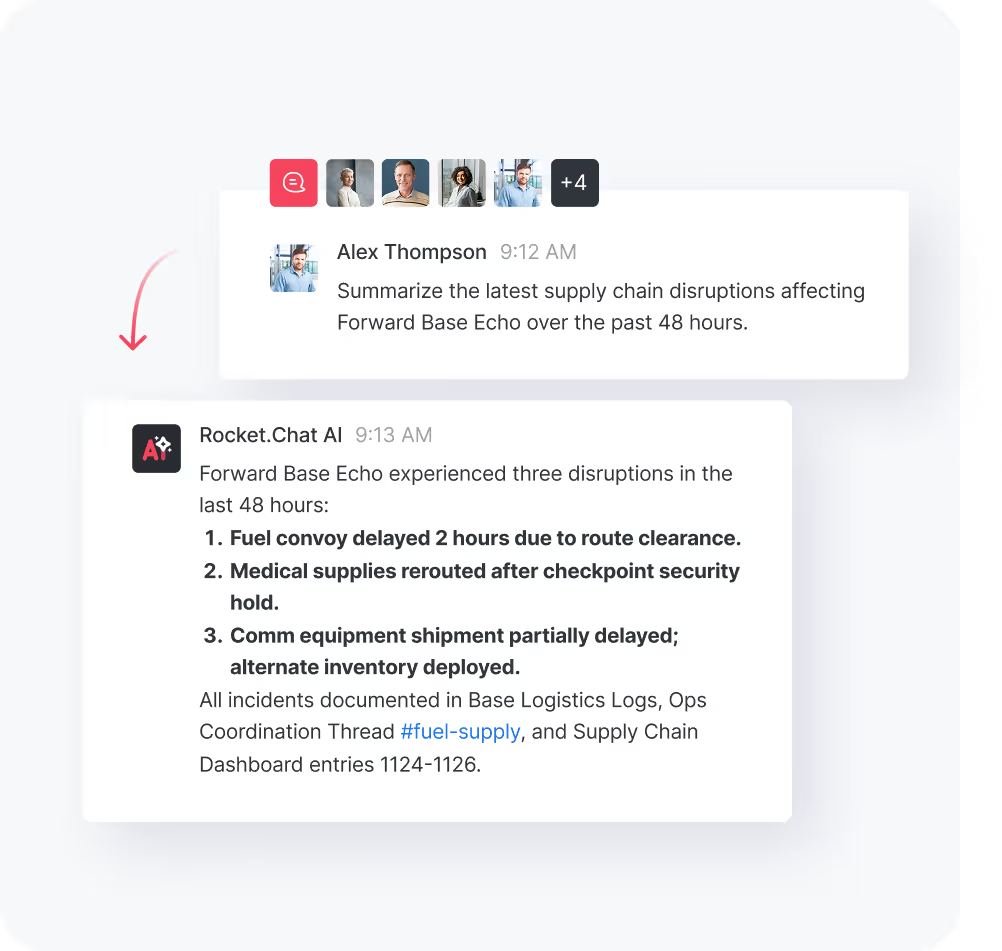

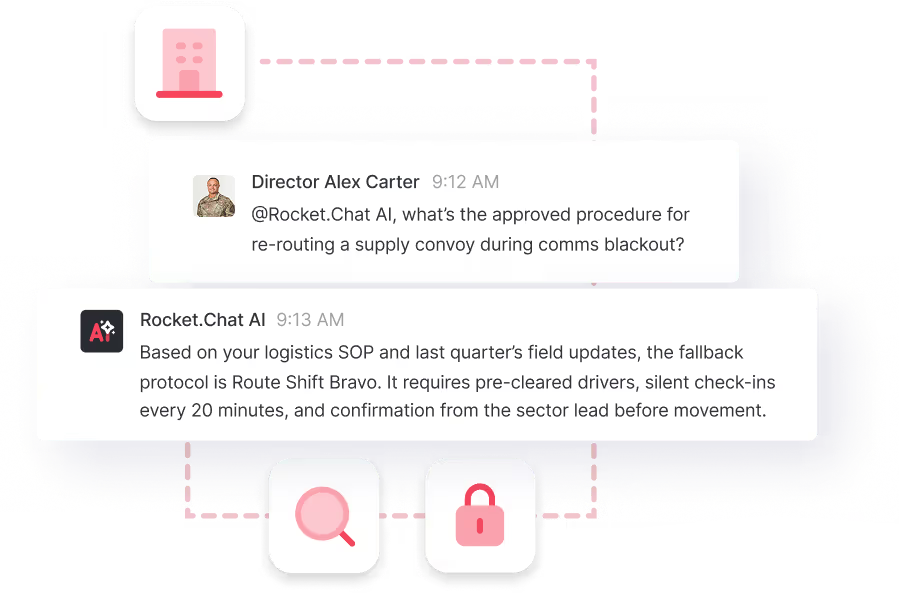

Aprovecha el conocimiento interno, los manuales y los procedimientos operativos estándar para que la IA ofrezca respuestas prácticas,

y ricas en contexto en las que los equipos puedan confiar al instante.

Rastrea las respuestas hasta sus fuentes, garantizando la auditabilidad y la confianza operativa.

.avif)

Añade contexto e historial a las consultas para obtener respuestas precisas a la primera, reduciendo las idas y venidas en misiones de alto riesgo.

.avif)

Proporcione respuestas incrementales y traducciones en tiempo real para respaldar operaciones multilingües seguras y e

es en todas las misiones e idiomas.

.avif)

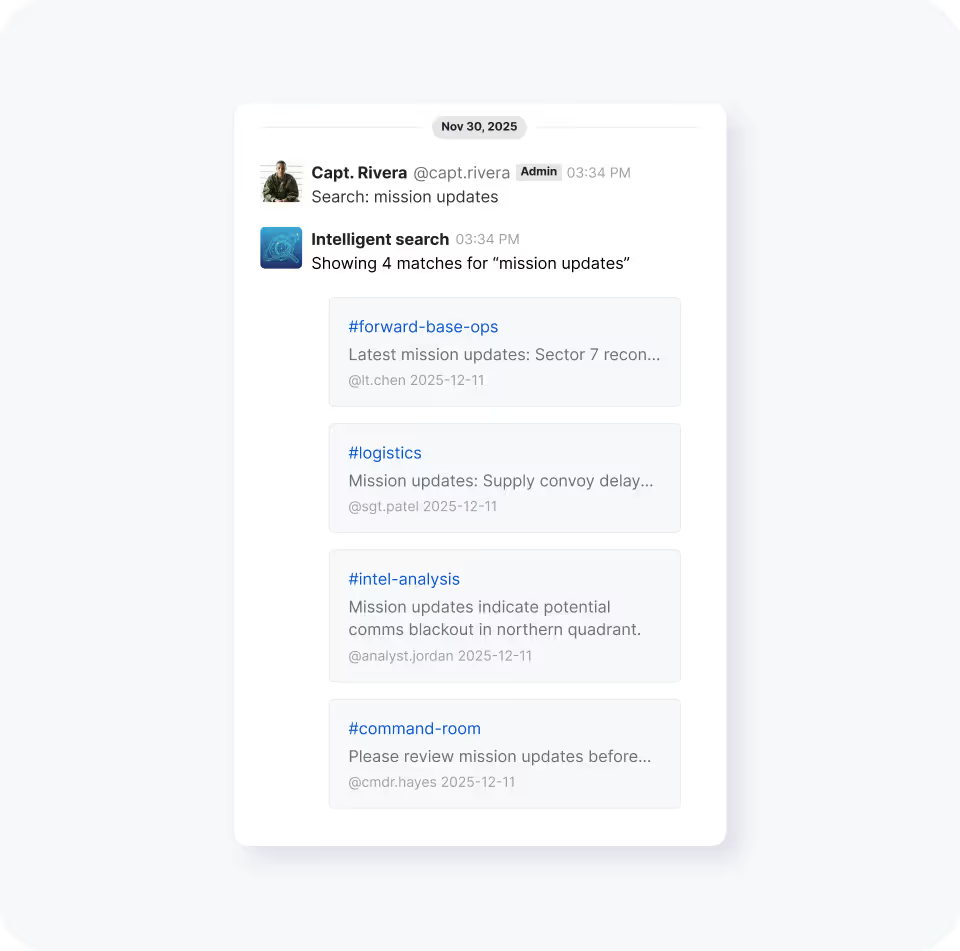

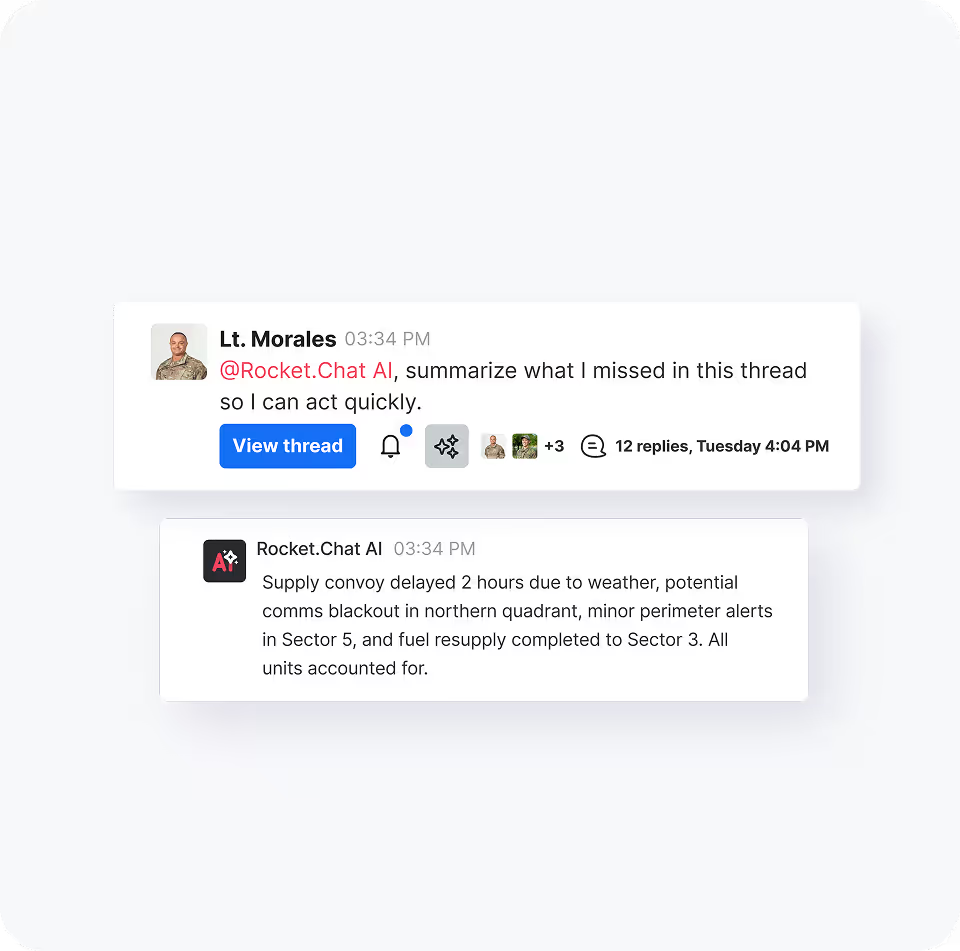

La búsqueda semántica y el resumen basado en inteligencia artificial muestran los mensajes, hilos y archivos más relevantes de todo tu espacio de trabajo. Los resultados respetan las funciones y las políticas de acceso para una recuperación rápida y segura.

.avif)

.avif)

Historia de un cliente

Dennis Wong, director y cofundador, Master Concept

Rocket.Chat AI (RAI) está diseñado para operaciones de alto riesgo. Cada decisión de diseño garantiza la soberanía, la aplicación de políticas y una inteligencia verificable en la que sus equipos pueden confiar.

RAI se ejecuta completamente dentro de su entorno, por lo que todos los datos, las inferencias y las recuperaciones permanecen bajo su control.

RAI aplica controles RBAC, de clasificación y de avisos para garantizar que solo los usuarios autorizados puedan ver la información.

RAI utiliza de forma segura sus datos privados a través de RAG para ofrecer respuestas contextuales y alineadas con la misión.

Cada respuesta se remonta a su fuente y clasificación para que los equipos puedan verificar, en lugar de confiar ciegamente.

La búsqueda comprende la intención y el significado para combatir los silos de información y mostrar rápidamente la información adecuada.

Los administradores controlan la ingesta, la indexación, la retención y el acceso para que la IA se mantenga alineada con las políticas de la misión.

.avif)

¿Listo para comenzar?

Los gobiernos están avanzando hacia la soberanía digital para mejorar su independencia y proteger sus datos de la interferencia regulatoria extraterritorial.

Los gobiernos impondrán requisitos de soberanía para la IA para 2028.

Gartner